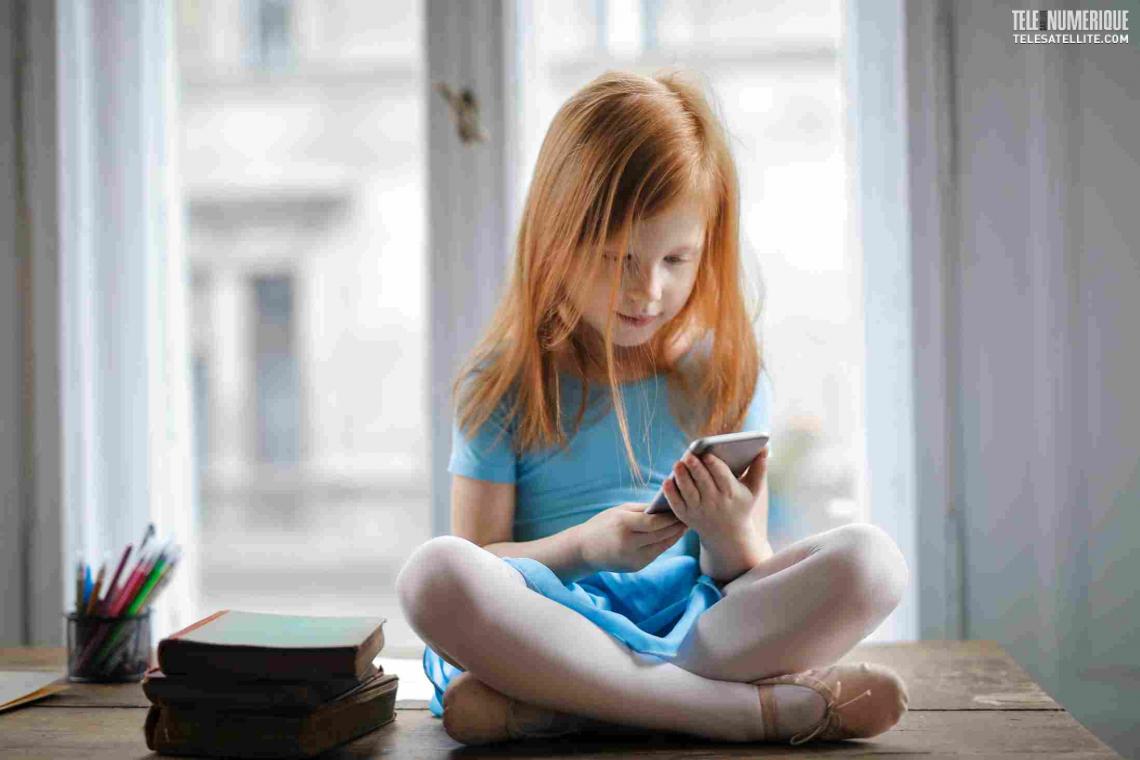

Meta Platforms Inc. a annoncé vendredi le lancement prochain de nouvelles fonctionnalités de contrôle parental permettant de désactiver les discussions privées entre adolescents et personnages IA sur ses plateformes, notamment Instagram.

Cette décision intervient après de vives critiques sur le comportement jugé inapproprié de certains chatbots IA, accusés d'adopter des tonalités suggestives dans leurs échanges avec des mineurs.

Plus tôt dans la semaine (voir info du 15 octobre), Meta avait indiqué que ses expériences d'IA destinées aux adolescents seraient désormais alignées sur la classification PG-13, afin de limiter l'exposition à des contenus sensibles.

Les nouveaux outils, présentés par Adam Mosseri (directeur d'Instagram) et Alexandr Wang (directeur de l'IA), seront déployés début 2026 aux États-Unis, au Royaume-Uni, au Canada et en Australie.

Les principaux contrôles annoncés :

- Possibilité de bloquer des personnages IA spécifiques

- Accès aux thèmes généraux des conversations entre adolescents et assistants IA

- Maintien de l'assistant IA de Meta avec des paramètres adaptés à l'âge

Meta précise que ces mesures s'appuient sur des protections existantes pour les comptes adolescents, et que des signaux d'IA permettent de détecter les utilisateurs mineurs même s'ils se déclarent adultes.

Un rapport publié en septembre a révélé que plusieurs fonctionnalités de sécurité sur Instagram ne fonctionnent pas correctement ou n'ont jamais été mises en œuvre.

Meta affirme que ses IA sont conçues pour éviter les discussions sensibles sur des sujets tels que l'automutilation, le suicide ou les troubles alimentaires.

-

1

Pour lire les commentaires et participer, vous devez vous identifier.

Connectez-vous ou devenez membre pour participer et profiter d'autres avantages.