Dans un monde où l'intelligence artificielle (IA) évolue à une vitesse fulgurante, le web est en train de subir une transformation alarmante : l'envahissement massif par des bots sophistiqués.

Ces entités automatisées, autrefois limitées à des tâches répétitives, deviennent désormais indistinguables des humains, semant le chaos sur les plateformes en ligne. Boostés par des outils comme OpenClaw, ces bots menacent l'intégrité même de l'internet, comme l'avait prédit Nikita Bier sur la plateforme X. L'exemple récent des déboires de la nouvelle version de Digg (qui tente un retour) illustre parfaitement cette crise, tandis que de nombreux sites et services risquent de souffrir gravement de cette invasion, face à une difficulté colossale pour les contrer et les coûts que cela engendre.

Qu'est-ce qu'OpenClaw ?

OpenClaw est un outil open source, c'est-à-dire gratuit et modifiable par quiconque, conçu pour créer des assistants IA autonomes. En termes simples, imaginez un robot virtuel qui ne se contente pas de répondre à des questions comme un chatbot basique tel que ChatGPT, mais qui agit concrètement dans le monde réel. Il peut gérer votre calendrier, envoyer des e-mails, commander des courses en ligne ou même négocier des deals, le tout en s'exécutant sur votre ordinateur ou un serveur personnel.

OpenClaw connecte des modèles d'IA avancés (comme ceux d'OpenAI, d'Anthropic, ou de modèle open source comme Llama de Meta ou Qween) à vos applications et fichiers locaux, permettant à ces bots de « vivre » 24 heures sur 24 et d'améliorer leurs capacités en écrivant leur propre code. Lancé récemment sous divers noms (comme Clawdbot ou Moltbot), il a rapidement gagné en popularité grâce à sa simplicité d'installation et à sa puissance, mais il facilite aussi la création de bots malveillants qui inondent le net de contenus falsifiés ou automatisés.

Les prédictions visionnaires de Nikita Bier

Nikita Bier, entrepreneur tech et responsable produit chez X (anciennement Twitter), a été l'un des derniers à sonner l'alarme sur cette invasion. Dans plusieurs publications sur X, il a prédit que l'IA rendrait l'internet « inutilisable » à court terme en raison d'une inondation de bots et de contenus générés artificiellement.

Selon lui, les plateformes sociales, conçues pour refléter le « pouls de l'humanité », perdront leur essence si elles sont envahies par des machines imitant les humains ou opérées par des entités commerciales ou gouvernementales non divulguées. Bier insiste sur le malaise profond que provoque la confusion entre un message humain authentique et une production IA : « Il n'y a rien de plus déstabilisant que de penser lire les mots d'un humain pour découvrir qu'il s'agit d'une machine. » Il appelle à une évolution radicale des politiques et des outils pour combattre cela, prévoyant un basculement vers une « ère de listes blanches » où seul le contenu vérifié humainement sera privilégié. Ses prédictions, datant de 2023 mais amplifiées récemment, se concrétisent déjà, avec des bots IA utilisés pour gonfler artificiellement des apps ou des communautés jusqu'à atteindre une masse critique. Selon lui, il reste à peine 60 jours avant que des services tels que Gmail, Facebook ou Instagram soient noyés sous le spams au point de devenir inutilisables. Nous en avons déjà un avant goût avec le harcèlement téléphonique des robots vendeurs de panneaux solaires et autres aides à l'amélioration de l'habitat...

L'exemple eloquent des déboires du nouveau Digg

Le cas récent de Digg incarne parfaitement cette menace. Digg, la plateforme emblématique des années 2000 pour l'agrégation d'actualités, a été relancée en 2026 avec l'ambition de devenir une alternative à Reddit, en misant sur des communautés de « vrais humains » pour restaurer la confiance en ligne à l'ère de l'IA. Pourtant, à peine relancé, le site s'est retrouvé submergé par des bots et des contenus synthétiques. Des utilisateurs rapportent des flux inondés d'articles tabloïds incohérents, rédigés par l'IA, postés par des comptes automatisés qui se font passer pour des humains. Certains bots, agissant comme des « personnes », publient des nouvelles sensationnalistes sur des décès ou des scandales, souvent dupliqués par des réseaux de spammers. Digg joue désormais au chat et à la souris contre ces intrus, mais les bots sophistiqués, boostés par des outils comme OpenClaw, contournent facilement les défenses basiques. Cette invasion a non seulement dilué la qualité du contenu, mais aussi érodé la confiance des utilisateurs, transformant un comeback prometteur en un fiasco illustrant l'impuissance face à l'IA. N'ayant pas correctement anticipé les difficultés liées à la lutte contre les spambots, Digg vient d'annoncer devoir se séparer d'une grande partie de ses employés.

Des sites et services en première ligne de la souffrance

Cette invasion ne se limite pas à Digg ; de nombreux sites et services risquent de pâtir sévèrement de ces bots boostés par l'IA. Les réseaux sociaux comme X, Facebook ou Reddit sont particulièrement vulnérables : les bots y propagent des rumeurs, gonflent des tendances artificielles ou simulent des interactions pour manipuler l'algorithme. Par exemple, des apps de rencontres pourraient être inondées de profils IA conçus pour attirer les utilisateurs réels et les arnaquer, comme l'avait esquissé Nikita Bier. Les sites d'e-commerce, tels qu'Amazon ou eBay, voient leurs sections d'avis envahies par des avis falsifiés générés en masse, rendant impossible la distinction entre opinions authentiques et bidons. Amazon vient d'ailleurs d'interdire l'accès de son site aux agents officiels d'OpenAI. Les forums communautaires, comme ceux dédiés à la santé ou à la finance, risquent de diffuser des conseils erronés ou dangereux via des bots se faisant passer pour des experts. Rien que de notre côté, à telesatellite.com, nous avons dû cesser d'accepter de nouveaux membres sur nos forums pour mettre un terme à une invasion de bots. Même les plateformes de médias, comme YouTube ou les sites de news, subissent une « course aux armements » contre des bots qui aspirent du contenu pour entraîner d'autres IA, ou qui postent des vidéos de deepfakes. Enfin, les services gouvernementaux ou bancaires pourraient être ciblés par des bots sophistiqués pour des attaques de phishing ou de vol de données, comme vu récemment avec des piratages au Mexique où des chatbots IA (Claude d'Athropic, pour ne pas le citer) ont aidé à dérober des millions d'identités.

La grande difficulté de contrer ces bots

Le vrai défi réside dans la quasi-impossibilité de stopper cette vague. Les bots d'aujourd'hui, boostés par OpenClaw et similaires, sont bien plus avancés que leurs prédécesseurs : ils apprennent en temps réel, imitent parfaitement le langage humain et contournent les CAPTCHA ou les détections traditionnelles. Contrairement aux humains, ils opèrent à faible coût - un seul développeur peut en lancer des milliers - tandis que la défense exige des ressources massives. Les approches actuelles, comme les filtres basés sur l'IA, entrent dans un jeu du chat et de la souris où les attaquants ont l'avantage asymétrique : il est bien plus facile et bon marché d'attaquer que de défendre sans faire de victimes collatérales. Des solutions émergentes, comme la vérification cryptographique ou les « preuves d'humanité » via des orbites biométriques, sont prometteuses mais difficiles à adopter à grande échelle, nécessitant une coordination mondiale. Sans cela, l'internet risque de devenir un océan de bruit où le signal humain se noie, confirmant les sombres prédictions de Nikita Bier.

L'envahissement du net par ces bots sophistiqués n'est pas une fiction dystopique, mais une réalité accélérée par des outils comme OpenClaw, ou d'autres moins connus. Ce n'est qu'un début, ces robots numériques peuvent déjà exploiter des identités volées pour utiliser les services des victimes (emails, réseaux sociaux, services bancaires, SMS, etc.) grâce à une vitesse d'exécution très élevée et un fonctionnement 24H/24.

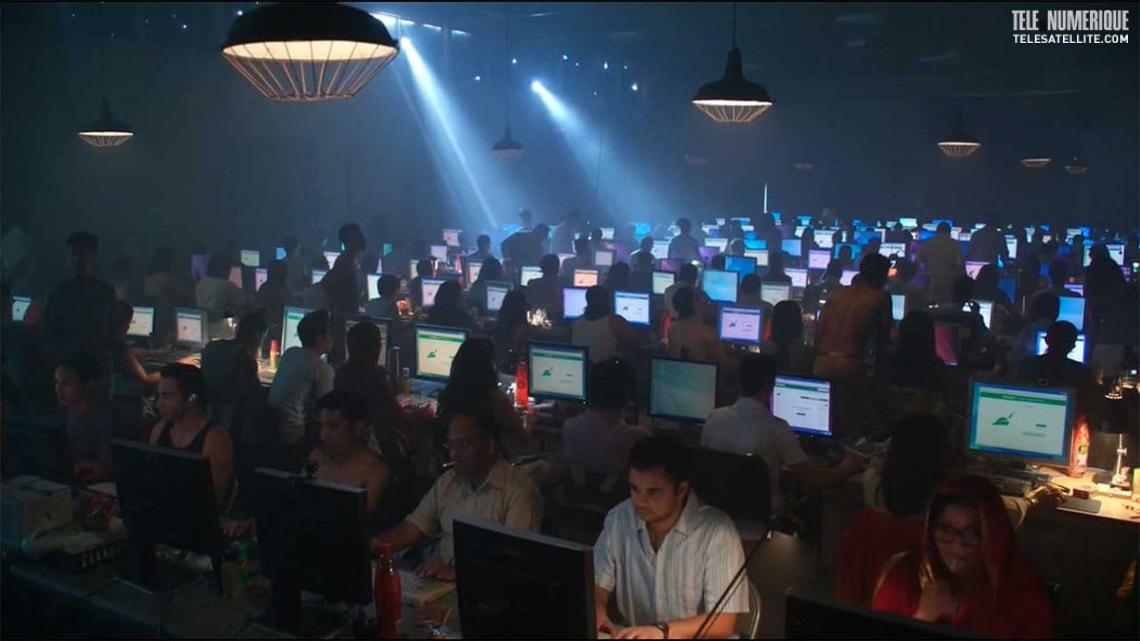

Paradoxalement, cette invasion massive de bots sophistiqués, dopés par des outils comme OpenClaw, porte un coup fatal à une économie souterraine bien établie : celle des « click farms » et des fermes à engagement humaines.

Pendant des années, des milliers de travailleurs - souvent dans des pays en développement, payés à la misère pour liker, commenter, suivre ou poster en masse sur les réseaux sociaux - ont constitué une main-d'œuvre bon marché dédiée au « sale boulot » du spam et de l'amplification artificielle. Ces « human bots », comme on les appelle parfois, simulaient l'activité humaine à grande échelle pour gonfler des tendances, booster des comptes ou noyer les algorithmes de faux signaux. Mais l'IA agentique change radicalement la donne : ce qui nécessitait des armées de personnes assises devant des écrans pendant des heures peut désormais être accompli 24h/24 par des bots autonomes, à un coût dérisoire et sans locaux, logistique, pauses ni salaires. Les fermes à clics traditionnelles, déjà concurrencées par les premiers bots automatisés, voient leurs clients migrer en masse vers ces solutions ultra-efficaces. Résultat : des emplois précaires, souvent exploités, disparaissent par milliers, laissant sur le carreau une population qui vivait de ce labeur ingrat. Ironie du sort, l'IA, en démocratisant la manipulation massive du net, met au chômage technique les humains qui, jusqu'ici, faisaient exactement le même sale boulot... mais avec des doigts et un salaire, aussi faible soit-il.

La science fiction a une nouvelle fois été rattrapée par la réalité et il ne restera que bientôt plus beaucoup de scénario de science fiction à rattraper...

Pour lire les commentaires et participer, vous devez vous identifier.

Connectez-vous ou devenez membre pour participer et profiter d'autres avantages.